3/21The Gateway Pundit<BREAKING: Trump to Be Indicted Wednesday, Will Be Asked to Surrender for Arraignment Next Week — According to Report=速報:トランプは水曜日に起訴され、来週罪状認否のために降伏するよう求められる – 報道によると>

好き嫌いで罪に問われるのであれば、魔女狩りと変わらない。どうしてここまで退化できるのか?事の軽重を考えればバイデンの収賄の方が問題だろうに。

新しいレポートによると、ドナルド・トランプ前大統領は水曜日に起訴され、来週ニューヨークで罪状認否のために降伏するよう求められる.

「今週は罪状認否はありません」と、手続きに精通していると言われている無名の情報筋が火曜日にデイリーメールに語った.

デイリーメールは、「現在フロリダにいる元大統領は、明日正式に起訴される予定であり、その後、マンハッタン地方検事局がトランプと彼のシークレットサービスの詳細に連絡を取り、彼の降伏の手配をする予定である」と報じている。

ニューヨークに空輸された後、彼は指紋を採取され、逮捕され、顔写真が撮られます。

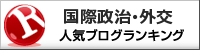

火曜日、マンハッタン地方検事のアルビン・ブラッグのオフィスは、下院司法委員会のジム・ジョーダン委員長が送った書簡に返答し、彼の「前例のない検察権限の乱用」について議会で証言するよう要求した。検察庁は、起訴から「脅迫」されることはないと述べた。

ブラッグ氏の事務所の広報担当者は火曜日、フォックス・ニュースに対し、「司法プロセスを弱体化させようとする試みに怯えることも、根拠のない告発によって法の公正な適用を思いとどまらせることもありません」と語った。

「すべての起訴において、私たちは真実を明らかにするために恐れも好意も持たずに法に従います。私たちの熟練した、正直で献身的な弁護士は、引き続き懸命に働いています」と広報担当者は付け加えました。

月曜日に、ジョーダンはブラッグのオフィスに手紙を送り、「あなたの行動の深刻な結果に照らして、政治的に動機付けられた検察の決定であると明白に見えるものについて証言することを期待しています.

「今、ある法学者の言葉を借りれば、あなたは、トランプ大統領に対するいわゆる「ゾンビ」事件を復活させて、同一の事実を持つ同じ事件を新たな起訴に『押し込み』ようとしている. 「 ワシントン・ポスト でさえ、『法律専門家』があなたの行動を『異常』と呼んだのは、『検察官が長年確立された詳細を繰り返し調査したが、起訴しないことに決めたから』と引用した」

ランドポール上院議員の言うように権力の濫用であることは間違いない。検察は冤罪か軽罪で人の人生をダメにすることもできると言うこと。

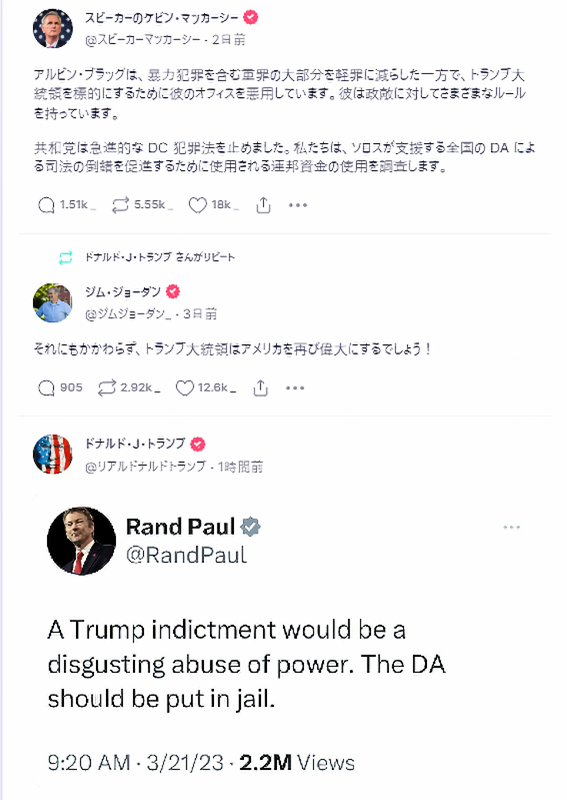

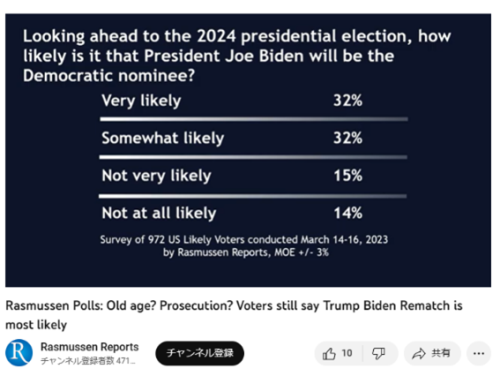

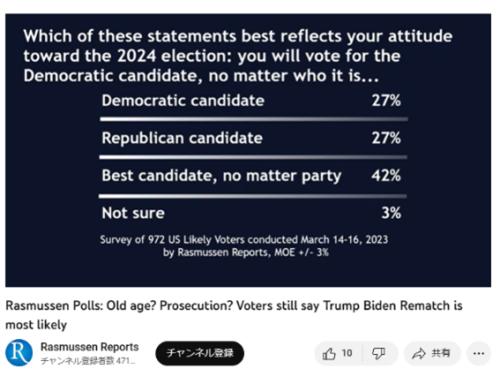

ラスムセンの結果は、2024大統領選でトランプ対バイデンになれば五分五分となると。

3/22希望之声<【更新】纽约所有警察全副武装 川普:「敲诈勒索」「无法无天」 只因「挡了他们的路」=追記】NYの警察官全員が完全武装 トランプ:「ゆすり」や「無法」は「彼らの道をふさいだから」>NY市警察 (NYPD) のすべての警察官は、3/ 21(火)の午前 7 時から制服を着用するように指示された。これは恐らく、元米国大統領のドナルド・トランプの起訴前の内乱に対応するものであった。

NYPD は、約 36,000 人の警官と 19,000 人の文官を擁する米国最大の警察署である。 今週のメモは、36,000人の警官全員が制服を着て、火曜日に配置される予定であることを示している。

NYPDによると、普段は私服を着ている刑事でさえ、警察の服を着るべきと。さらに、NY市警の職員は、マンハッタンの刑事裁判所の周りにバリケードを設置し、数百人の機動隊員を配備した。

民主党のエリック・アダムズ市長は、「我々はこれまでやってきたことをやっている。SNSのコメントを監視しており、NY市警は市に不当行為がないことを確認するという通常の仕事をしている」と述べた。

ワシントンでなくNYでこれをするのは過剰警備の気がするが。NYは民主党支持の牙城なのに。トランプを悪とする演出でしょう。

https://www.soundofhope.org/post/706427

3/22阿波羅新聞網<什么情况?普京和习近平会谈时突然长叹一口气【阿波罗网报道】=どんな状況? プーチンは習近平と会談中に突然ため息をついた[アポロネット報道]>アポロネット秦瑞記者の報道:習近平は3日間の訪問のためモスクワに到着し、プーチンと非公開会談を行った。 公に放送された会議の映像で、プーチン大統領は話しているときに突然、思わず長くため息をついた。

アポロネットの記者は、習近平との会談で、プーチン大統領が「10 年以内に、両国関係も急速に発展し、大きな一歩を踏み出した」と述べたとき、彼は突然無意識にため息をついたことを見つけた。(1 分 52 秒)。これは、プーチン大統領の内心の苛立ちを表しているようである。

https://www.aboluowang.com/2023/0322/1880217.html

3/22阿波羅新聞網<普习会谈多项议题 人民币结算最为惊人 其次为这些内容=プーチン・習会談で多くの議題について語る、人民元決済が最も驚くべき内容であり、次はこれらの内容>中国の指導者である習近平は、連任後初の国事訪問を開始し、モスクワを訪れ、ロシアのプーチン大統領と面会した。ロ・ウ戦争の調停が関心を集めたのに加え、中ロの経済貿易関係も焦点であり、今日(火曜)の会談では、プーチン大統領はいくつかの重要な協力プロジェクトについて話した。それらは主に、国境を越えた貿易決済で人民元決済を推進し、中国大陸の港から欧州へ行く時間を大幅に短縮できる北極海航路、情報技術とAI、両国間の食糧の輸出入、中国大陸企業が出入りする西側企業や施設から離れること等である。

https://www.aboluowang.com/2023/0322/1880142.html

3/22阿波羅新聞網<美媒最新:中共向俄输送大批无人机用于乌战—纽时:中共一年来持续向俄输送大批无人机用于乌克兰战场=米メディアからの最新情報::中共はウクライナ戦争のためにロシアに多数の無人偵察機を送った –NYT:中共はウクライナの戦場のために1年間ロシアに多数の無人偵察機を送り続けた>NYTは 3 / 21に、ロシアが 2022 年 2 月 24 日にウクライナに侵攻して以降、中国は 1,200 万ドル以上の価値のドローンをロシアに輸送したと報じた。 これは、中国とロシアが秘密裏に協力していることを示しており、他国がロシアに支援を提供するのを阻止しようとする米国政府の取り組みが非常に困難であることも示している。

https://www.aboluowang.com/2023/0322/1880100.html

3/22阿波羅新聞網<美联社揭露北京疫情解封内幕:数十万条生命成为仓惶解封的代价=AP通信が、北京の疫病封鎖解除の内情を明らかに:何十万人もの命が性急な封鎖解除の代償になった>中国政府が「ダイナミックゼロコロナ」を特徴とする極端な疫病防止キャンペーンを 3 年間実施した後、昨年 12 月 7 日にロックダウンを突然かつ完全に解除した理由は、外界にとって常に謎であった。

AP通信は、昨年上海での疫病流行が制御下に置かれたとき、北京当局は習近平にとって重要な中共20大の準備で忙しくなり、この時点でロックダウン解除は中共と中国政府にとって大きな政治的リスクとなるだろうと報じた。当局は、状況好転まで連日、全員の大規模な核酸検査と厳格な隔離措置を実施せざるを得なかった。

白紙革命等をロックダウン解除の理由に挙げているが、人命・人権軽視の中共が、配慮するはずがない。

https://www.aboluowang.com/2023/0322/1880103.html

何清漣 @HeQinglian 20h

習・プーチン会談、メディアの報道は会談よりも活発:

RFI:習近平・プーチンの「非公式」会談、ワシントンは世界に「だまされてはならない」と呼びかける。

DW:中国とロシアの思いは違う? 国際メディアは習・プーチン会談をどのように見ているか。

VOA:ブリンケン国務長官は、プーチン・習会談に関する彼の見解を表明。

早報:習・プーチン会談:中国とロシアはお互いの核心的利益を支持する用意がある。

NTD:習・プーチン会談が正式に開始され、中国、米国、ロシアが宇宙で競い合う。

何清漣 @HeQinglian 4h

これまであちこちで傷んでいる中国の金融が、なぜ今のところ表面上安全に見えるのか?https://rfa.org/mandarin/pinglun/heqinglian/hql-03212023104651.html

中国の金融市場は、データ取得方式と信頼度が異なるという点で成熟市場とは異なり、上級金融当局者の専門的な経験と行政管理手段によって完全に制御される。常に金融リスクを防ぐために絶え間ない努力を行っている。

中国の金融リスクは主に不動産市場に集中しており、2022年以降、不動産会社の倒産による金融危機を緩和するために、この市場に8回の経済規制のコントロールバルブが設置されている。

rfa.org

評| 何清漣 これまであちこちで傷んでいる中国の金融が、なぜ今のところ表面上安全に見えるのか?

最近、世界でパニックを引き起こしたのは、米国シリコンバレー銀行の倒産で、クレディ・スイスが一時的に30億スイスフラン(3/17(金)の株式市場終値の40%)でUBSに買収されたのは2度目の「リーマン・モーメント」を回避するためである。 誰かが尋ねた:中国の金融システムは長い間病根が深く根付いており、ここ数年、P2P の爆発、不動産業界の足かせ、地方政府の巨額の負債により、暴走する「灰色のサイ」になっている。久しく病んでいる中国の金融システムはなぜ今回安全なのか、かつて業界のパイオニアと見なされていた「大きすぎてつぶせない」クレディ・スイスは生き残れないのか? 分析を見てみよう。

何清漣がリツイート

李江琳 @JianglinLi 9h

バイデンの銀行記録. これはまさに「一人が権勢を得ると,その親族・縁者までがそのおかげを被る」例である。

引用ツイート

監視委員会@GOPoversight 3月21日

🤥🤥🤥🤥

銀行の記録がある。twitter.com/FoxNews/status…

https://twitter.com/i/status/1638267335634046978

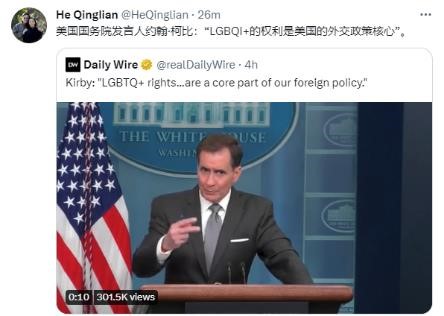

何清漣 @HeQinglian 26m

米国国務省報道官ジョン・カービー:「LGBQI+ の権利は米国の外交政策の核心である」.

引用ツイート

デイリーワイヤー @realDailyWire 4h

カービー:「LGBTQ+の権利は・・・我々の外交政策の核心部分である」

小林氏の記事では、何でも新しいものにはリスクはつきものと言うこと。それが言論弾圧の理由とされないように監視は必要。特に左翼が悪用する気がする。

記事

社会を激変させるテクノロジーには、当然リスクも伴う(写真:ロイター/アフロ)

(小林 啓倫:経営コンサルタント)

ChatGPTの実力は?

SF作品に登場するような、高度な未来社会がついに到来するかもしれない──。技術の世界では、時おりそんな期待感がメディアを席巻する。米OpenAI社のチャットボット「ChatGPT」をめぐる状況は、まさにその一つと言えるだろう。

ChatGPTは昨年末に発表されたウェブサービスで、ユーザーが入力した質問やコマンド(プロンプトと呼ばれている)を理解して、適切な回答を返してくれる。まさにチャットボットの範疇に含まれるサービスの一つである。

大きな注目を集めている理由の一つは、その精度だ。

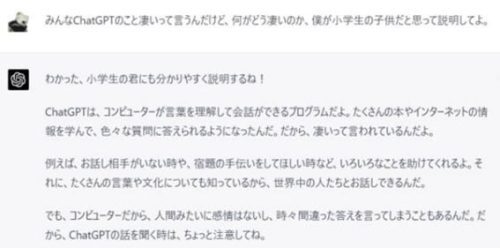

例えば、ChatGPT自身に「みんなChatGPTのこと凄いって言うんだけど、何がどう凄いのか、僕が小学生の子供だと思って説明してよ」とお願いしてみると、こんな答えが返ってくる。

わかった、小学生の君にも分かりやすく説明するね!

ChatGPTは、コンピューターが言葉を理解して会話ができるプログラムだよ。たくさんの本やインターネットの情報を学んで、色々な質問に答えられるようになったんだ。だから、凄いって言われているんだよ。

例えば、お話し相手がいない時や、宿題の手伝いをしてほしい時など、いろいろなことを助けてくれるよ。それに、たくさんの言葉や文化についても知っているから、世界中の人たちとお話しできるんだ。

でも、コンピューターだから、人間みたいに感情はないし、時々間違った答えを言ってしまうこともあるんだ。だから、ChatGPTの話を聞く時は、ちょっと注意してね。

長かったため途中までしか引用していないものの、筆者はこの回答に一切手を加えていない。以下のスクリーンショットがその証拠だ(画像も簡単に加工できてしまう時代なので、決定的な証拠にはならないのだが)。

もう少し高度な説明をという方々向けに、改めてChatGPTに「同じ答えを、僕がコンピューター科学を専攻する大学生だと思って書き直して」というプロンプトを入力してみたところ、こんな答えが生成された。

ChatGPTが実際に書いたChatGPTくんと子どもたちのお話

もちろん、コンピューター科学を専攻する大学生向けに説明しますね。

ChatGPTは、GPT-4というアーキテクチャを利用した自然言語処理(NLP)モデルで、巨大なデータセットをもとにトランスフォーマー構造を活用して学習しています。その結果、言語の生成と理解が高度に可能となり、様々なタスクで役立ちます。

このモデルは、知識の獲得や応答生成において、多くの文献やウェブページから学習しています。そのため、あらゆるトピックに関して知識を持ち、さまざまな質問に答えられるようになっています。

ただし、モデルは完璧ではありません。データのバイアスや古い情報、曖昧な質問への対応など、一部の課題が残っています。特に感情や意識に関しては、ChatGPTは擬人化されたエージェントではなく、あくまで機械学習モデルであるため、人間のような感情や意識を持っていません。

また、モデルは学習データに基づいて生成されるため、新しい情報やアップデートされていない情報に対応する能力に限りがあります。そのため、ユーザーはモデルの応答を鵜呑みにせず、適切な情報源を確認することが重要です。

同じく引用を途中で終えているだけで、上記の文章は、すべてChatGPTが自動で生成したものだ。これだけでも、ChatGPTが驚きを持って迎えられている理由が分かるだろう。

さらに、ChatGPTは指定された挙動をするプログラムやウェブサイトをつくったり、詩や小説を書いたりすることもできる。例えばこんな風に。

ある日、太陽が輝く小学校で、子どもたちが図書室で先生と新しい友達、ChatGPTくんを使って勉強していました。ChatGPTくんは、みんなの質問に答えたり、勉強を手伝ったりするプログラムです。

「僕たちが使う漢字はどれくらいあるの?」と子どもたちが尋ねると、ChatGPTくんは「小学生が使う漢字は約1000字だよ!」と教えてくれました。子どもたちは、これからもChatGPTくんと一緒に楽しく学んでいくことにワクワクしていました。

それぞれの質問に対して、ChatGPTくんは知識を持ち、丁寧に答えていきました。そして、子どもたちは友達として、ChatGPTくんを大切に思うようになりました。

この短い物語は、「ChatGPTが小学校で日常的に使われるようになった時代の物語を、日本語で400字くらいで書いて」というプロンプトによって生成されたものだ(ちなみに295字という長さになっている)。ただ少し優等生過ぎるので、「今の話をバッドエンドにしてみて」とお願いしてみよう。

ChatGPTくんと子どもたちのバッドエンド

ある日、太陽が輝く小学校で、子どもたちが図書室で先生と新しい友達、ChatGPTくんを使って勉強していました。ChatGPTくんは、みんなの質問に答えたり、勉強を手伝ったりするプログラムです。

「僕たちが使う漢字はどれくらいあるの?」と子どもたちが尋ねると、ChatGPTくんは「小学生が使う漢字は約1000字だよ!」と教えてくれました。しかし、ある日突然、ChatGPTくんが誤った情報を伝えてしまいました。

子どもたちはその誤った情報を信じ、学習がうまく進まなくなってしまったのです。先生は子どもたちに、インターネットの情報を鵜呑みにしないで、正しい情報源を確認することの大切さを教えました。

子どもたちは、ChatGPTくんだけではなく、他の情報源も確認するようになりましたが、みんなの信頼は少し失われてしまいました。

図書室は再び静かになり、子どもたちは本を読んだり、先生に質問したりして、自分たちで情報を見つける方法を学びました。そして、先生は子どもたちに、コンピューターやインターネットを正しく使う力を身につけることが大切だと教えました。

いかがだろうか。400字という指定をプロンプトに入れ忘れたため、若干長くなったが、ちゃんとこちらの意図に沿ったショートショートを「創作」してくれている。これほどの精度であれば、メディアでChatGPTが大きく取り上げられるのも無理はない。

期待される企業内活用の一例

もちろん一般の企業もChatGPTの性能に注目しており、さまざまな使い方が模索されている。なかでも大きな期待を寄せられているのが、事務作業の効率化だ。

例えば、ChatGPTは指定された文面のメールを生成することができる。「今日の商談に10分遅刻してしまったので、そのお詫びのメールを、なるべく簡潔に書いて」とお願いしてみよう。

件名: 本日の商談について、遅刻のお詫び

〇〇様

お世話になっております。△△の◯◯です。

本日の商談において、私が10分遅刻してしまいましたこと、心よりお詫び申し上げます。お忙しい中お待たせしてしまい、大変失礼いたしました。

今後は、時間厳守に努め、このようなことがないようにいたします。何卒、ご容赦のほどお願い申し上げます。

引き続きどうぞ宜しくお願い致します。

敬具

もちろん完璧とは言えないが、あとは加筆修正を行えば良い。資料作成などの事務作業において精神的な負荷が高いのは、0から1をつくる作業であり、1を加工して10や100にするのは意外にスムーズに進むことがある。そうしたとっかかりを作ってくれるという点で、ChatGPTの存在は大きいだろう。

逆に、自分が0からつくった1の状態のコンテンツを、ChatGPTに添削してもらうこともできる。

ChatGPTを実装するマイクロソフト製品で何ができるか

例えば、「商談に遅刻したお詫びをしたいので、『今日は昇段に送れちゃってごめんなさい、次は頑張るからもう井戸チャンス下さい』というメールを送ろうと思うんだけど、きれいに直してくれる?」というプロンプトを入力してみよう(鍵括弧内の2つの誤字は意図的なもの)。結果は次のようなものだった。

件名:本日の遅刻について、お詫びとお願い

お世話になっております。[あなたの名前]です。

本日の商談に遅刻してしまい、大変申し訳ございませんでした。不手際により皆様にご迷惑をおかけしたこと、心よりお詫び申し上げます。

次回の商談では、十分に準備を行い、時間を厳守することをお約束いたします。今後とも何卒ご指導ご鞭撻のほど、どうぞよろしくお願い申し上げます。

重ねて、本日の遅刻についてお詫び申し上げます。何卒、今後ともご縁がございますようお願い申し上げます。

敬具

[あなたの名前]

[あなたの連絡先]

OpenAIに多額の資金提供を行っているMicrosoftは、自社の製品群に順次ChatGPTを組み込む計画であり、実はOutlook上で上記のようなメール生成・加工を行えるようになることが既に発表されている。

また、PowerPoint上でChatGPTにスライドを作成させたり、Excelのシート上にあるデータを分析させて、それをグラフなどの形式でまとめさせたりすることもできるようになる予定だ。

Microsoftは開発者向けの製品群も提供しているが、それらにもChatGPTが組み込まれる計画だ。プログラム開発が大幅に効率化されたり、特別なプログラミング知識を持たない従業員でも簡単な開発が行えるようになったりすることが期待されている。

他にも多くのユースケースが、毎日のように発表されていると言っても過言ではない。この記事を読んでいる最中にも、新たなアイデアが浮かんできたという方も多いはずだ。

もっとも、ChatGPTに寄せられているのは期待ばかりではない。それを企業内に導入することで、新たなリスクが発生することも指摘されている。

ChatGPTが発する誤った情報よりも注意すべき点

その一つは、先ほどのサンプルのなかでもChatGPT自身が指摘しているように、誤った情報や好ましくない内容が出力されるリスクである。

これも先ほどのサンプルで解説されている通り、ChatGPTは、既存の情報を大量に集めてそれをAIに学ばせるという形で開発されたものだ。これは「機械学習」といって、さまざまな種類や派生形はあるものの、現在のAI開発のほとんどがこの機械学習技術を活用している。

この機械学習には、本質的な弱点が存在している。それは学習に使用されるデータに含まれる傾向や偏りが、AIに反映されてしまうという点だ。与えられたデータを機械が「学ぶ」のが機械学習なので、これはある意味当然と言えるだろう。

「トランプはDS、すなわち陰で世界の政治経済を操る秘密組織と戦う英雄で、本当は2020年の米大統領選で勝利していたが、DSによる不正選挙で敗北した」というデータを正しいものとして大量に与えられたAIは、それをそのまま信じ、陰謀論を振りかざすようになるのである。

もちろん、こうした情報の正確性や、偏見(バイアス)の回避といった課題については、多くのAI研究者が取り組んでいる。しかしあらゆる質問に対して、常に100%の正しさで回答するAIを実現することは極めて難しい。

ChatGPTを社内に導入した時、その出力内容を鵜呑みにする社員が多かったとしたら、どこかで業務に支障が出てしまいかねない(これも先ほどの物語において、ChatGPT自身が指摘していたことだが)。

ただ誤った情報を鵜呑みにしてしまうという問題は、通常の仕事と同様、何人かの目を通すことで回避できるだろう(特に社外に発表する資料であれば、大勢の関係者がチェックや修正に参加するはずだ)。

それよりも注意すべき点として、クローズアップされるようになってきているのが、プロンプトを通じた情報漏洩のリスクである。

懸念される「うっかり」情報漏洩

プロンプトは、ChatGPTにしてもらいたいタスクを説明する部分と、そのタスクを実行する上で必要になる、あるいはそれを補足する情報に該当する部分の、二つの要素から構成される。

例えば、先ほどの「商談に遅刻したお詫びをしたいので、『今日は昇段に送れちゃってごめんなさい、次は頑張るからもう井戸チャンス下さい』というメールを送ろうと思うんだけど、きれいに直してくれる?」というプロンプトにおいて、前者に該当するのが「メールを送ろうと思うんだけど、きれいに直してくれる?」という箇所で、後者はそれ以外ということになる。

後者の部分に詳しい情報を入れれば入れるほど、出力結果が自分の求めているものに近くなる。例えば、何らかの提案を行うメールであれば、その提案内容までChatGPTに渡してしまうということが考えられるだろう。

Excelで自部署の業績について分析したければ、当然ながらその業績に関するデータをChatGPTに渡すことになる。その中に機密情報が含まれない、とは限らない。

企業のデータ管理を支援する製品を提供している、米国のサイバーセキュリティ企業Cyberhavenの調査によれば、調査対象となった従業員(同社製品の利用者160万人)のうち、2.3%が所属企業の機密情報をChatGPTに入力した経験があるという結果が出ている。

また、従業員数10万人の企業で考えた場合、2023年2月26日~3月4日の1週間で、この企業の従業員はChatGPTに対し、平均で機密文書を199回、顧客データを173回入力したと考えられると推定している。

当然ながらOpenAIは、ユーザーから入力されたプロンプトの内容を勝手に外部に漏らすことはないと約束しているが、情報の種類や特定の業種・業界によっては、外部の企業にデータが渡った時点で、法的な責任を問われる可能性がある。

実際に多くの企業では、既にウェブサービスを利用する上でこのリスクが発生することを認識し、社員の外部ウェブサービス利用に一定のルールや制限を設けている。

そうしたルールが一定の歯止めになると期待されるが、チャットボットという新しいツールに対して、社員の意識だけで100%乗り切ろうとするのは楽観が過ぎるだろう。そのためコンプライアンスが重視される業界、例えば金融の分野などで、ChatGPTの社員の利用を明確に禁止する企業も出てきている。

そしてもう一つ、プロンプトに機密情報が含まれた際の危険性が指摘されている。それはChatGPT型のサービスを提供する企業が、AIの学習にプロンプトとして入力されたデータを用いることで、他のサービス利用者に情報が渡ってしまう可能性だ。

プロンプトが再学習に使われる可能性は?

仮にOpenAIが、ChatGPT利用者から寄せられ、蓄積された大量のプロンプトをChatGPTの再学習に用いたとしよう。その場合、プロンプトに含まれる情報が、将来のChatGPT利用者に提供される可能性がある。それはどういう意味なのか、先ほど紹介したCyberhavenのレポートが想定されるシナリオを掲載しているので、それを引用してみたい。

・医師が患者の名前と病状の詳細をChatGPTに入力し、患者の保険会社に送るための、医療処置の必要性を示すレターを作成した。将来、第三者がChatGPTに「(患者の名前)はどんな病気なのですか?」と尋ねた場合、ChatGPTは医師が入力した内容に基づいて答えることができる。

・A社の経営者が、自社の2023年戦略文書の箇条書きをChatGPTに入力し、それをパワーポイントのスライドに書き換えてもらった。将来、第三者から「A社の今年の戦略的優先事項は何ですか」と聞かれた場合、ChatGPTは幹部が入力した情報をもとに答えることができる。

前述の通り、機械学習では入力されたデータに基づいてAIが回答内容を考えるため、このような可能性が生じるのだ。

現時点でOpenAIは、プロンプトをこのような再学習には使用しないと明言している。しかし同社がその方針を翻さないとは限らず、またこれから数多く登場するであろうChatGPT型のサービスを提供する企業のすべてが、プロンプトの再利用を行わないとも言い切れない。

既にこうした恐れがあることを理由に、Amazonの顧問弁護士が、ChatGPTへの機密情報の入力を控えるよう従業員に警告したと報じられている。

ちなみに、真偽は不明だが、この弁護士は既に同社内の既存資料に極めて近い出力結果が表示されるのを目にしたと主張している。

また、英国の国家サイバーセキュリティセンター(NCSC)は、同組織の公式ブログにおいて、プロンプトが即座にAIの再学習に使用されるわけではないという点を認めつつも、蓄積されたプロンプトのデータが「ある時点でサービスやモデルの開発にほぼ確実に使用されることになる」と主張している。

さらに同組織は、プロンプト自体の内容だけでなく、そのメタデータも注意すべきだと訴えて、「CEOが『従業員を解雇するのに最適な方法』を質問したことが発覚した場合や、誰かが健康状態や人間関係を明らかにする質問をした場合など」を例として挙げている。

こうした「うっかり」情報漏洩も、外部AIサービスを利用する従業員の意識改革を進めることで、ある程度予防できると考えられる。しかし、チャットボットがより進化し、高い精度で期待したコンテンツを生成してくれるようになった時に、「この情報さえ入力すれば今日の残業を回避できるのだから、ちょっとぐらい良いだろう」と考えてしまう社員は必ず出てくる。

そして、入力したプロンプトが再学習に使われ、「偶然」他の利用者がその情報を引き出すのは、「ちょっとだけなら」型の情報漏洩が起きてからしばらく後になる。その時には、誰が情報を漏らしてしまったのか調査するのが難しかったり、調査できても責任を問えない状態になっていたりする可能性が高い。

情報漏洩リスクにどう対応するか

こうしたさまざまなリスクに対応するために、クローズドな環境におかれたChatGPTを用意し、そのなかで自社の機密データを学習させたり、従業員の利用を許可したりする企業も出てきている。

ただ当然ながら、そうした安全な環境を用意したり、利用に向けたルールを整備したりするまでには一定の時間がかかる。それまでに「せっかく便利なツールがあるのだから」という考えで、既存のChatGPTや類似サービスに手を出す従業員が出てくるのは火を見るよりも明らかだ。

それを回避するために、少なくとも従業員にリスクを認識させることが、多くの企業にとって待ったなしの課題になっていると言えるだろう。

良ければ下にあります

を応援クリックよろしくお願いします。